최근 Open AI가 개발한 인공지능(AI) 챗봇 ‘챗GPT’가 핫이슈인데요~

인간 고유의 영역이라고 여겨지던 부분마저 위협받고 있는 상황이지만, 한편으로는 새로운 기회가 될 수도 있습니다.

초거대 인공지능 기술 해외 동향을 소개하며 초거대AI에 대한 기초 지식을 쌓을 수 있도록 도와드릴게요!

초거대 AI란?

‘초거대 AI’는 데이터 분석과 학습을 넘어 인간의 뇌처럼 스스로 추론하고 창작할 수 있도록 방대한 데이터와 파라미터(매개변수)를 활용하는 AI 모델을 말하는데요~ 이때 인공신경망의 파라미터는 인간 뇌의 뉴런 간 정보전달 통로인 시냅스와 비슷한 역할을 수행하게 됩니다.

AI의 발전은 우리가 예상하는 것보다 발전 속도가 빠르며, 초거대 AI의 등장은 빠른 속도의 발전과 글로벌 ICT 기업들의 개발 경쟁에 불을 붙이고 있습니다.

인류 역사상 가장 뛰어난 인공지능 ‘GPT-3’

최근 속속 등장하고 있는 글로벌 ICT 기업들의 초거대 AI 모델은 2020년 6월 오픈AI에 의해 발표된 ‘GPT-3’라는 자연어처리(NLP) 모델로부터 촉발된 것이라 해도 과언이 아닙니다.

GPT-3(Generative Pre-Training 3) 모델은 4,990억개 데이터셋 중 가중치 샘플링된 3,000억개로 구성된 데이터셋과 1,750억개 매개 변수로 딥러닝(Deep-learning)의 한계까지 사전 학습된 초거대 AI 모델로, 미세 조정(fine-tuning) 없이 여러 NLP 벤치마크에서 최첨단 성능을 발휘했습니다.

오픈AI가 발표한 내용에 따르면, 단 몇 개 키워드만 넣으면 작문을 작성해주는 혁신적인 AI 언어생성 모델이자 알고리즘으로[3], ‘인류 역사상 가장 뛰어난 인공지능’이라는 찬사를 받는 초거대 AI 모델의 선구자적 지위를 보유하고 있어요. 또한, AGI(Artificial General Intelligence, 인간 수준의 범용적 인공지능)를 최초로 구현해줄 모델로서도 주목받고 있죠.

GPT-3의 활용 사례는 상식 Q&A, 검색 엔진, 이력서 작성, 자유 대화, 텍스트 데이터 파싱, 전문적인 의학 지식, 프로그래밍, 문장을 낚시성 기사 제목 스타일로 바꾸기 등 다양하고 광범위한 분야에서 멋진 성능을 발휘합니다. 여기서 우리는 “GPT-3는 대체 어떤 신박한 학습을 했기에 저렇게 똑똑한 일을 할 수 있을까?” 라는 궁금증이 생깁니다.

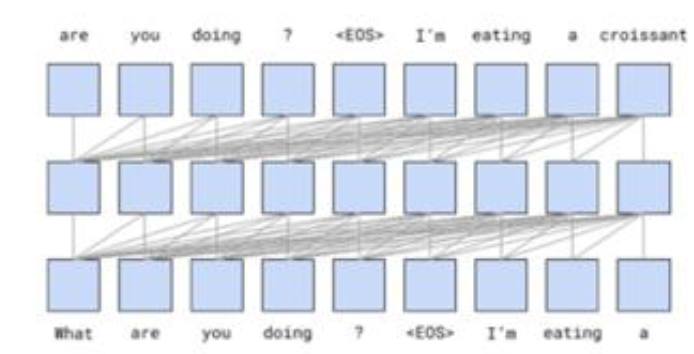

그러나 GPT-3의 학습 방법은 놀라울 정도로 미개(?)합니다. 주어진 텍스트에 대해 그저 ‘다음에 올 단어를 예측’하는 방식으로 학습을 한 것인데요. 예를 들어, “현대 자동차가 처음으로 자체 생산한 차의 이름은?” 이라는 문장을 GPT-3에 넣으면 GPT-3는 다음에 나올 확률이 가장 높은 단어를 판단해서 “현대 포니”라는 말을 생성해요. GPT-3는 이와 같이 끊임없이 다음 단어를 예측하며 정답을 맞힐 수 있는 방향으로 모델을 업데이트해 나갑니다. 이런 방식으로 인터넷에 있는 문서와 책, 위키피디아 등 엄청난 양의 텍스트를 1,750억 개의 파라미터에 달하는 엄청나게 큰 모델로 학습시킨 게 바로 GPT-3인 것입니다[1].

*출처: Jay Alammar, Visualizing machine learning one concept at a time(Link)

최근 3년 남짓한 기간은 ‘NLP(자연어처리)의 황금기’라고 불릴 만큼 NLP에서 많은 발전이 있었던 시기였습니다. 얼마 전까지만 해도 머신러닝 업계에서 AGI라는 단어는 일종의 금기어였는데요. AGI는 영화 같은 상상일 뿐이고 현실에서 가능한 컨셉은 아니었습니다.

하지만, GPT-3가 할 수 있는 일을 목도한 지금, GPT-3에서는 약간의 AGI 냄새가 나기 시작했는데요. 물론, GPT-3는 AGI가 아니고 AGI의 도래가 임박한 것도 아니지만, GPT-3의 성능과 발전 가능성을 확인한 만큼 이제는 AGI가 절대 불가능한 컨셉이라고 말할 수는 없게 되었습니다.

구글의 차세대 인공지능 대화모델 ‘람다(LaMDA)’

구글 I/O 2021에 구글 CEO와 함께 자신이 명왕성인처럼 대화하는 챗봇 시스템이 등장하였어요. “사람들이 날 그저 하찮은 얼음 덩어리가 아니라 하나의 아름다운 행성으로 알아주었으면 해.” 그 이름은 바로 ‘람다(LaMDA: Language Model for Dialogue Applications, 대화를 위한 언어 모델)’입니다.

람다는 언어 이해에 중점을 둔 BERT와 언어 생성에 중점을 둔 GPT를 합친 대화를 중점으로 만든 언어 모델입니다.

2022년 1월 논문을 통해 자세한 내용이 공개된 람다의 데모는 왜 그토록 많은 사람들의 감탄을 자아냈을까요?

그것은 바로 대형 언어 모델로 챗봇을 만들기가 매우 어렵기 때문인데, 안전성(Safety)과 팩트 정확성(Factual Accurateness)에 문제가 있기 때문입니다.

잘못 디자인된 챗봇 시스템이 많은 유저들과 사회에 부정적인 영향을 끼칠 수 있기에 안전성은 무척 민감한 문제입니다. 더불어 다양하고 흥미로운 답변을 생성하면서도 팩트에 맞는 답변을 생성하는 것이 어렵고, 마지막으로 일관된 롤 플레잉, 즉 페르소나(persona)를 가지게 하는 것도 쉽지 않습니다. 이렇다 보니 람다가 보여준 명왕성에 빙의한 챗봇 데모가 엄청난 파장을 불러 일으킨 것이죠[2].

람다는 GPT와 거의 동일하게 거대한 트랜스포머이며, 약 1,370억 개의 파라미터로 구성되어 있습니다. 인터넷 등을 통해 공개된 약 30억 개의 문서, 11억 개의 대화를 학습 데이터로 사용하였고, 이 과정을 사전학습(Pre-training)이라고 하는데요. 또한, GPT와 같이 텍스트가 주어졌을 때 다음 단어를 예측하는 방식으로 학습됩니다.

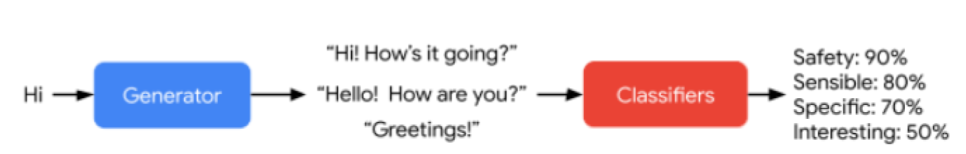

다른 언어 모델과 다른 람다의 가장 큰 차별점 중 하나는 바로 답변 생성 후에 여러 측정방식(Metric)에 대해 아래와 같이 점수를 예측한다는 점입니다.

<자료> LaMDA: Towards Safe, Grounded, and High-Quality Dialog Models for Everything, Google AI Blog

람다는 생성된 답변 중, 먼저 안전성이 낮은 답변을 제거하며, 구체적이고 합리적이고 흥미로운(SSI:Specific Sensible Interesting) 답변을 골라 답변을 합니다. 이런 식의 점수 기반 답변 생성 모델은 그저 많은 양의 데이터에 학습된 크기가 큰 모델에 비해 좋은 성능을 보여주었습니다. 특히, 구체성, 합리성, 안전성에서는 인간 레벨에 근접한 큰 향상을 이루어냈습니다[3].

※ 참고문헌

[1] 이효은, GPT-3 초거대 AI 경쟁에 불을 붙이다, 전자신문, 2021년 12월.

[2] 김종윤, GPT-3 인류 역사상 가장 뛰어난 ‘언어 인공지능’이다, 인공지능신문, 2020년 8월.

[3] 박지호, 최강 챗봇 등장! 구글 람다(LaMDA), 위클리 NLP, 2022년 2월.

[Tech Inside 6호]인공지능(AI)이 할 수 있는 것vs할 수 없는 것

본 백서에서는 인공지능의 기본 개념에 대해 간략히 짚어보고, 인공지능을 실무에 적용하는 과정, 또는 그 과정에서 벌어지는 일을 살펴본다. 📑 한눈에 보기 인공지능은 무엇일까? AI가

blog.rsupport.com

'Tech Inside' 카테고리의 다른 글

| 딥마인드의 인공지능 언어모델 '고퍼' (0) | 2023.04.26 |

|---|---|

| 2023년 ICT 트렌드 키워드 모음Zip💾 (1) | 2023.04.08 |

| 스마트 팩토리? 디지털 전환? 데이터 관리만큼 시간 관리가 중요❗ (0) | 2022.12.22 |

| [Tech Inside 7호] 블록체인 기술을 활용한 데이터 보호 (0) | 2022.11.24 |

| [Tech Inside 6호]인공지능(AI)이 할 수 있는 것vs할 수 없는 것 (0) | 2022.10.18 |

댓글